Ja jūs, tāpat kā es, regulāri esat tiešsaistē, tad jūs noteikti esat uzdūrušies mākslīgā intelekta ģenerētiem video. Daži no jums, iespējams, pat ir eksperimentējuši ar to, izveidojuši video un kopīgojuši tos savos sociālo mediju kanālos. Bet vai esat kādreiz domājuši, vai saturs patiesībā pieder jums vai nē?

Vai saturs, ko publicējat, ir aizsargāts ar autortiesībām, kas atrodas jūsu vārdā, vai arī tas ir free lai ikviens to varētu pārstrādāt un atkārtoti izmantot? Tieši to mēs aplūkosim emuāra ierakstā. Autortiesību jautājumi, ētiskās pelēkās zonas un viss pārējais tiks detalizēti aplūkots turpmākajos rakstos.

Kas ir dziļviltojumi un mākslīgā intelekta ģenerēti video?

Ar mākslīgā intelekta ģenerētiem video tiek izmantota mašīnmācīšanās un uzlaboti valodu modeļi, lai sintezētu video, attēlus un runu ar cilvēka līdzību. Savukārt dziļviltojumi tiek izmantoti, lai reālās dzīves video mainītu sejas, balsis un žestus.

Šis saturs tika izmantots, lai atvieglotu vizuālo efektu izveidi un izklaidē. Taču šī tehnoloģija ir pārgājusi no šīs nišas uz mārketingu, sociālajiem medijiem, izglītību un tā tālāk. Tā ir atvieglojusi satura ģenerēšanu un pat palīdzējusi mazajiem uzņēmumiem veidot saturu ar mazāku budžetu.

Diemžēl dziļviltojums un mākslīgā intelekta ģenerēts saturs var izplatīt dezinformāciju un radīt autortiesību bažas, tāpēc dziļa viltojumu noteikšana ir kļuvusi svarīga digitālo mediju autentiskuma pārbaudei. Tāpēc ir jāsaprot ētiskie un konfidencialitātes jautājumi, kas saistīti ar mākslīgā intelekta saturu, lai to varētu izmantot atbildīgi.

Uzlabojiet sociālo mediju ieguldījumu atdevi ⚡️

Ietaupiet laiku un veidojiet plašā mērogā, izmantojot AI

MĒĢINIET TAGADKam pieder mākslīgā intelekta ģenerēts multivide?

Kad mākslinieks vai satura veidotājs glezno vai veido video, saturs parasti tiek attiecināts uz mākslas darbu veidotāju. Šādā gadījumā ir skaidri izcelts gan autortiesībām pakļautais saturs, gan persona, kurai tas pieder.

Taču problēma ar mākslīgā intelekta ģenerētu multividi un dziļviltojumiem ir tā, ka nav skaidra veidotāja un īpašnieka, kas nozīmē, ka arī autortiesību ierobežojumi ir neskaidri. Mākslīgais intelekts tiek apmācīts ar lielu datu apjomu, uz kura pamata tiek izstrādāts gala produkts.

The Intelektuālā īpašuma likumi joprojām ir diezgan neskaidras attiecībā uz iespēju aizsargāt ar autortiesībām mākslīgā intelekta ģenerētu saturu un tādējādi atstāt to neaizsargātu.

Papildu padoms ir dokumentēt un saglabāt savus radošos ieguldījumus, lai apliecinātu savu īpašumtiesības uz radīto darbu.

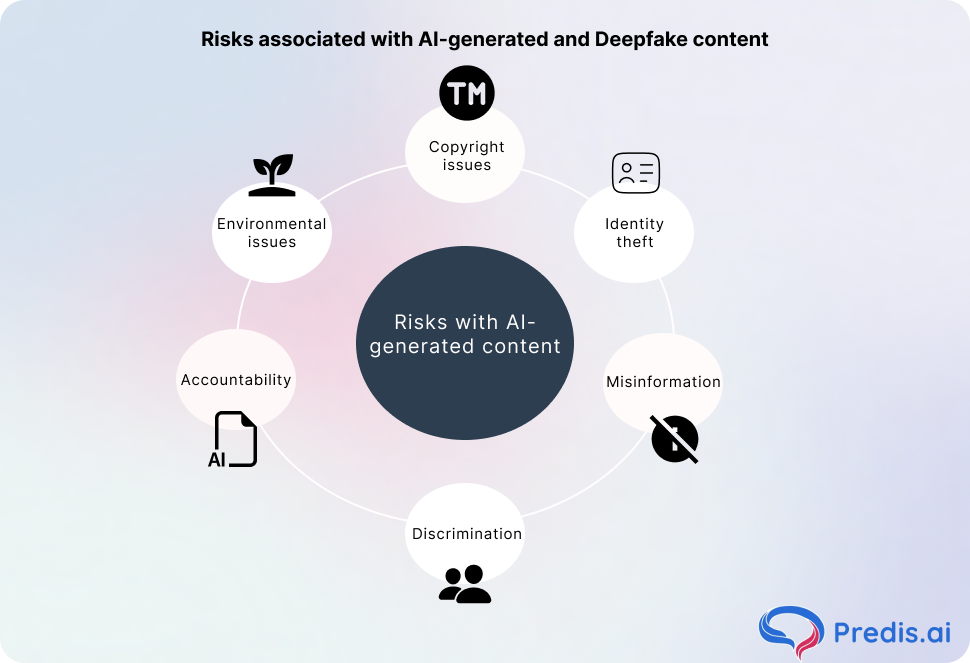

Ar mākslīgā intelekta ģenerētu un dziļviltojumu saturu saistītie riski

Tātad, kādi ir daži no riskiem, kas saistīti ar mākslīgā intelekta ģenerētu saturu un dziļviltojumiem, par kuriem jums jāzina? Šeit ir daži no tiem:

1. Autortiesību jautājumi

Tā kā mākslīgais intelekts iegūst rezultātus, mācoties no neskaitāmiem tiešsaistes materiāliem, tostarp ar autortiesībām aizsargāta satura, saturu nevar pilnībā klasificēt kā oriģinālu. Faktiski ASV autortiesību biroja vadlīnijas nosaka, ka darbus bez cilvēka autorības nevar aizsargāt ar autortiesībām.

Ja mākslīgā intelekta ģenerētais rezultāts nejauši izskatās līdzīgs citam ar autortiesībām aizsargātam saturam, tas radīs juridiskas komplikācijas.

2. Identitātes zādzība

Ja mākslīgā intelekta ģenerēta persona atgādina reālu personu, tas var izraisīt kaitīgu personības atveidošanu. Turklāt pastāv skaidra prasība, ka nedrīkst izmantot kāda līdzību bez šīs personas piekrišanas. Šīs prasības neievērošana bieži vien var radīt nopietnas problēmas, šantāžu un reputācijas bojājumus.

3. Dezinformācija un manipulācijas

Dziļie viltojumi var radīt ļoti reālistisku saturu, kas izplata nepatiesu informāciju, sapludinot robežu starp faktiem un izdomājumiem. Ja lietotāji nespēj atšķirt nepatiesu informāciju no patiesas, tam var būt nopietnas sekas. Tas var ietekmēt politiku, sagrozīt cilvēku viedokļus un pat apdraudēt kopienas.

4. Diskriminācija

Ja mākslīgais intelekts tiek apmācīts ar neobjektīviem datiem, tad arī tā ģenerētā izeja būs neobjektīva. Šāda negodīga attieksme var radīt rezultātus, kas neatspoguļo visu ainu. Tāpēc vienmēr ir jāsalīdzina mākslīgā intelekta ģenerētais saturs, lai pārliecinātos, ka netiek parādīti diskriminējoši ziņojumi.

5. Atbildība

Tā kā mākslīgā intelekta ģenerētajam saturam nav skaidra īpašnieka, nav neviena, kas būtu jāuzņemas atbildība par dezinformācijas izplatīšanu. Saukt kādu pie atbildības un novērst šādu negadījumu ir gandrīz neiespējami, tāpēc atbildības uzņemšanās ir ētisks jautājums. AI radīts saturs.

6. Oglekļa pēdas nospiedums

Izmantojot mākslīgo intelektu, sistēmas darbības uzturēšanai ir nepieciešams liels enerģijas un ūdens resursu daudzums, kas dabiski rada vides problēmas. Šī liela mēroga ietekme uz vidi ir arī ētiska problēma, kas jārisina.

Ētisko risku novēršana: atbildīgas mākslīgā intelekta nākotnes veidošana

Lai gan autortiesības un neslavas celšana ir galvenās bažas, svarīgākais jautājums ir: kā mēs varam atbildīgi izmantot mākslīgo intelektu jeb dziļviltojumus? Tas nav tikai juridisks jautājums — tas ir morāls. Ētiskas mākslīgā intelekta nākotnes veidošana prasa pūles no visām iesaistītajām pusēm: veidotājiem, tehnoloģiju uzņēmumiem, politikas veidotājiem un pat ikdienas lietotājiem.

Lūk, kā mēs varam sākt veikt šīs pārmaiņas.

1. Pārredzamība un izpaušana

Ja izmantojat mākslīgo intelektu (AI), lai izveidot saturu, esiet atklāti. Video, attēlu vai teksta apzīmēšana kā mākslīgā intelekta ģenerētu sniedz auditorijai kontekstu un palīdz izlemt, cik lielā mērā uzticēties redzētajam. Tas ir vienkāršs, bet spēcīgs solis uzticamības atjaunošanā sintētisko mediju laikmetā.

2. Regulējums un tiesiskais regulējums

Valdībām un starptautiskajām organizācijām ir jāmodernizē spēkā esošie likumi, lai risinātu mākslīgā intelekta ietekmes jautājumus. Tas ietver autortiesību skaidrojumu attiecībā uz mākslīgā intelekta darbiem, atbildības noteikšanu par kaitīgu vai maldinošu mākslīgā intelekta saturu un stingrāku privātuma aizsardzību. Likumam nevajadzētu kavēt inovācijas, taču tam ir jāaizsargā sabiedrība.

3. Aizspriedumu mazināšanas stratēģijas

Mākslīgais intelekts atspoguļo datus, ar kuriem tas tiek apmācīts, kas nozīmē, ka tas var arī atkārtot cilvēku aizspriedumus. Izstrādātāji to var mazināt, auditējot datu kopas, testējot modeļus attiecībā uz taisnīgumu un dažādojot apmācības materiālus. Šīs darbības var šķist tehniskas, taču tās ir ļoti svarīgas, lai nodrošinātu, ka mākslīgais intelekts netīši nediskriminē un neveido stereotipus.

4. Izglītība un plašsaziņas līdzekļi Liteenerģisks

Viena no labākajām aizsardzības metodēm pret dezinformāciju ir informētība. Mācīt cilvēkiem, kā to izdarīt. identificēt dziļviltojumus, faktu pārbaude saturā un kritiska domāšana par tiešsaistes medijiem var novērst manipulācijas. Skolām, organizācijām un platformām visām ir sava loma mediju veidošanā. litepikants.

5. Ilgtspējīga mākslīgā intelekta attīstība

Papildus ētikai un likumam pastāv arī jautājums par atbildību vides jomā. Mākslīgā intelekta sistēmas patērē daudz enerģijas, īpaši apmācību laikā. Virzība uz energoefektīviem modeļiem un zaļāku skaitļošanas praksi ilgtermiņā var padarīt mākslīgā intelekta inovācijas ilgtspējīgākas.

Kā uzņēmumi var saglabāt drošību

Zīmoliem, kas satura veidošanai izmanto mākslīgā intelekta rīkus, gudrākais solis ir saglabāt proaktivitāti. Šeit ir daži ātri padomi:

- Pirms AI rīku lietošanas vienmēr izlasiet to licences līgumus.

- Izvairieties augšupielādēt patentētus vai autortiesībām pakļautus materiālus kā ievades datus.

- Pievienojiet atrunas vai etiķetes, ja jūsu saturs ir veidots ar mākslīgā intelekta palīdzību.

- Izmantojiet mākslīgo intelektu ētiski — nemanipulējiet, nemaldiniet un neizliecieties par īstiem cilvēkiem.

- Esiet lietas kursā par mainīgajiem mākslīgā intelekta un autortiesību likumiem jūsu reģionā.

- Šo piesardzības pasākumu ievērošana aizsargā gan jūsu zīmola reputāciju, gan auditorijas uzticību.

Dominējiet sociālajos medijos 🔥

Palieliniet sociālo mediju rezultātus un IA, izmantojot AI

MĒĢINIET TAGAD

Nobeiguma domas

Mākslīgā intelekta ģenerēts saturs un dziļviltojumi ir radījuši satura izveide pieejams plašām masām, taču autortiesību jautājums joprojām ir nopietna problēma. Līdz ar šo iespēju nāk arī atbildība veidot saturu ētiski un neizmantot to dezinformācijas izplatīšanai.

Juristu aprindas strādā pie tā, lai panāktu, ka mākslīgā intelekta ģenerētu saturu var pienācīgi regulēt. Līdz tam laikam katra indivīda pienākums ir prioritāri piešķirt godīgumu un ētiski izmantot mākslīgo intelektu. Tātad piereģistrēties šim rīkam un izmantojiet mākslīgo intelektu atbildīgi!

Jautājumi un atbildes:

Ne vienmēr, līdz šim, mākslīgā intelekta ģenerēti video daudzos reģionos nav aizsargāti ar autortiesībām, jo tos pilnībā ģenerē mākslīgais intelekts. Ar autortiesību likumu palīdzību var aizsargāt tikai cilvēku radītu saturu.

Jā, jūs varat iesūdzēt tiesā par kādas personas attēla izmantošanu bez šīs personas piekrišanas, jo tas pārkāpj privātumu un izraisa neslavas celšanu, ja saturs ir maldinošs vai nievājošs.

Dažas smalkas pazīmes, piemēram, nedabisks apgaismojums, kļūmes un neatbilstošas lūpu kustības, var palīdzēt identificēt mākslīgā intelekta ģenerētu saturu. Dažas sociālo mediju platformas pat strādā pie mākslīgā intelekta atzīmju pievienošanas saturam, lai nodrošinātu, ka cilvēki netiek maldināti.