Si pasas mucho tiempo en internet, como yo, seguramente te has topado con vídeos generados por IA. Puede que incluso hayas experimentado con ellos, creando vídeos y compartiéndolos en tus redes sociales. Pero, ¿te has preguntado alguna vez si ese contenido te pertenece realmente?

¿El contenido que publicas está protegido por derechos de autor a tu nombre, o es...? free ¿Que cualquiera pueda reutilizarlo y reciclarlo? Eso es precisamente lo que vamos a abordar en el blog. Los problemas de derechos de autor, las zonas grises éticas y todo lo demás se analizarán en detalle en los próximos párrafos.

¿Qué son los deepfakes y los vídeos generados por IA?

Los vídeos generados por IA utilizan aprendizaje automático y modelos de lenguaje avanzados para sintetizar vídeos, imágenes y voz con apariencia humana. Los deepfakes, en cambio, se utilizan para intercambiar rostros, voces y gestos en vídeos de la vida real.

Este contenido se utilizaba originalmente para facilitar la creación de efectos visuales y en el ámbito del entretenimiento. Sin embargo, esta tecnología ha trascendido este nicho y se ha extendido al marketing, las redes sociales, la educación, etc. Ha simplificado la generación de contenido e incluso ha ayudado a pequeñas empresas a crearlo con presupuestos reducidos.

Lamentablemente, el contenido deepfake y generado por IA puede difundir información errónea y generar preocupaciones sobre derechos de autor, por lo que detección de deepfake Se ha vuelto importante verificar la autenticidad de los medios digitales. Por ello, es fundamental comprender las cuestiones éticas y de confidencialidad del contenido de IA para que pueda usarse de forma responsable.

¿Quién es el propietario de los medios generados por IA?

Cuando un artista o creador pinta o realiza un vídeo, el contenido generalmente se atribuye a la persona que lo realiza. En tal caso, se identifica claramente el contenido protegido por derechos de autor y a su titular.

Pero el problema con los medios generados por IA y los deepfakes es que no hay un creador ni un propietario claros, lo que significa que los límites de los derechos de autor también son difusos. La IA se entrena con grandes cantidades de datos, a partir de los cuales se crea el producto final.

La reunión de los acreedores es una audiencia en la que su fideicomisario, abogado y cualquier acreedor que desee asistir se reunirán y discutirán su bancarrota del Capítulo XNUMX. Puede ser intimidante saber que todos discutirán su situación; sin embargo, tenga en cuenta que esto es parte del proceso para todos. Los acreedores raramente aparecen en la reunión de los acreedores. Su abogado puede ayudarlo a revisar información y responder preguntas Leyes de propiedad intelectual Todavía existen bastante ambigüedades respecto a la posibilidad de registrar los derechos de autor del contenido generado por IA y, por lo tanto, dejarlo desprotegido.

Un consejo adicional es que puedes documentar y guardar tus contribuciones creativas para reivindicar tu propiedad sobre la creación.

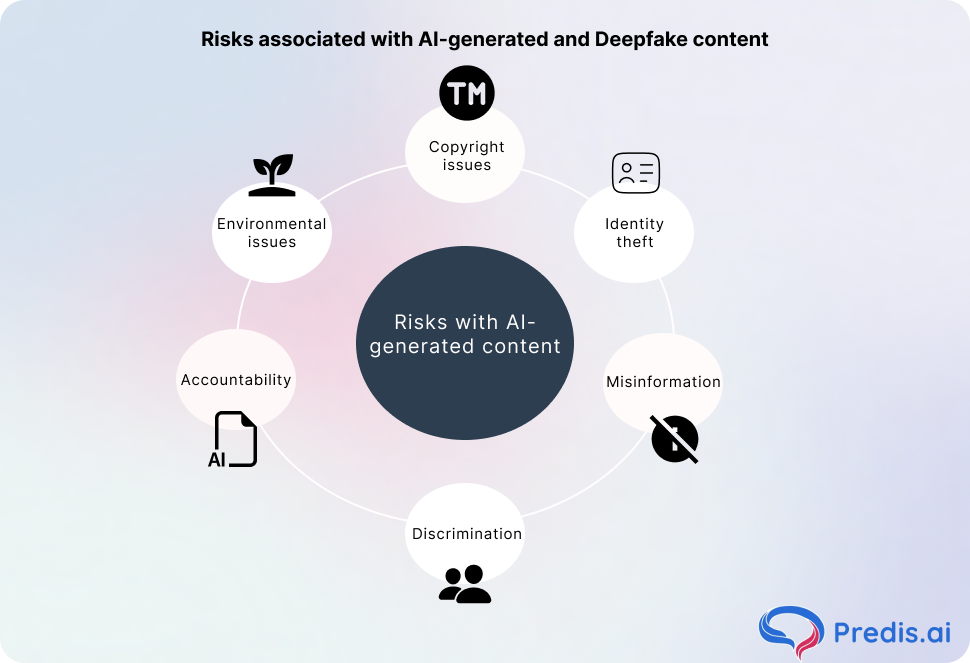

Riesgos asociados al contenido generado por IA y Deepfake

¿Cuáles son algunos de los riesgos asociados al contenido generado por IA y a los deepfakes que debes conocer? Aquí te presentamos algunos:

1. Cuestiones de derechos de autor

Dado que la IA obtiene sus resultados aprendiendo de innumerables materiales en línea, incluyendo contenido protegido por derechos de autor, dicho contenido no puede considerarse completamente original. De hecho, la Oficina de Derechos de Autor de EE. UU. establece que las obras sin autoría humana no pueden estar protegidas por derechos de autor.

Si el resultado generado por la IA se parece accidentalmente a otro contenido protegido por derechos de autor, entonces se desencadenarán complicaciones legales.

2 El robo de identidad

Cuando una persona generada por IA se asemeja a una persona real, puede dar lugar a una suplantación de identidad perjudicial. Además, existe la obligación explícita de no utilizar la imagen de alguien sin su consentimiento. Ignorar esta norma puede acarrear graves problemas, chantaje y daños a la reputación.

3. Desinformación y manipulación

Los deepfakes pueden crear contenido hiperrealista que difunde información falsa, difuminando la línea entre la realidad y la ficción. Cuando los usuarios no pueden distinguir entre información falsa y verdadera, las consecuencias pueden ser graves. Esto podría influir en la política, distorsionar la opinión pública e incluso poner en peligro a las comunidades.

4. Discriminación

Si la IA se entrena con datos sesgados, el resultado que genere también lo estará. Este trato injusto puede generar resultados que no reflejen la realidad completa. Por eso, siempre debes contrastar el contenido generado por la IA para asegurarte de que no se muestren mensajes discriminatorios.

5. Responsabilidad

Dado que el contenido generado por IA no tiene un propietario claro, no hay a quién responsabilizar cuando difunde información errónea. Exigir responsabilidades y evitar este tipo de incidentes es prácticamente imposible, por lo que la rendición de cuentas es una cuestión ética en este sentido. Contenido generado por IA.

6. Huella de carbono

El uso de la IA requiere un gran consumo de energía y agua para mantener el sistema en funcionamiento, lo que inevitablemente genera problemas ambientales. Este impacto ambiental a gran escala también plantea una cuestión ética que debe abordarse.

Abordar los riesgos éticos: Construyendo un futuro de IA responsable

Si bien los derechos de autor y la difamación son preocupaciones importantes, la pregunta fundamental es: ¿cómo podemos usar la IA o los deepfakes de forma responsable? No se trata solo de un problema legal, sino también moral. Construir un futuro ético para la IA requiere el esfuerzo de todos los involucrados: creadores, empresas tecnológicas, legisladores e incluso usuarios comunes.

Así es como podemos empezar a realizar ese cambio.

1. Transparencia y Divulgación

Si estás utilizando IA para crear contenidoSeamos transparentes al respecto. Etiquetar videos, imágenes o textos como generados por IA proporciona contexto al público y les ayuda a decidir cuánta confianza depositar en lo que ven. Es un paso sencillo pero poderoso para recuperar la credibilidad en la era de los medios sintéticos.

2. Regulación y marcos legales

Los gobiernos y los organismos internacionales deben modernizar las leyes vigentes para abordar el impacto de la IA. Esto incluye clarificar la titularidad de los derechos de autor de las obras creadas con IA, establecer la responsabilidad por el contenido de IA perjudicial o engañoso y garantizar una mayor protección de la privacidad. La ley no debe frenar la innovación, pero sí debe proteger a la ciudadanía.

3. Estrategias de mitigación de sesgos

La IA refleja los datos con los que se entrena, lo que significa que también puede reproducir sesgos humanos. Los desarrolladores pueden mitigar esto auditando los conjuntos de datos, probando la imparcialidad de los modelos y diversificando el material de entrenamiento. Estos pasos pueden parecer técnicos, pero son fundamentales para garantizar que la IA no discrimine ni estereotipe involuntariamente.

4. Educación y medios de comunicación Litepicante

Una de las mejores defensas contra la desinformación es la concientización. Enseñar a la gente cómo... identificar deepfakesVerificar el contenido y reflexionar críticamente sobre los medios en línea puede prevenir la manipulación. Las escuelas, las organizaciones y las plataformas desempeñan un papel importante en la construcción de medios. litepicante.

5. Desarrollo sostenible de la IA

Más allá de la ética y la legislación, también está la cuestión de la responsabilidad ambiental. Los sistemas de IA consumen mucha energía, sobre todo durante el entrenamiento. Avanzar hacia modelos energéticamente eficientes y prácticas informáticas más ecológicas puede hacer que la innovación en IA sea más sostenible a largo plazo.

Cómo pueden mantenerse seguras las empresas

Para las marcas que utilizan herramientas de IA para crear contenido, la estrategia más inteligente es ser proactivas. Aquí tienes algunos consejos rápidos:

- Lea siempre los acuerdos de licencia de las herramientas de IA antes de utilizarlas.

- Evite subir material propietario o protegido por derechos de autor como datos de entrada.

- Añade avisos legales o etiquetas si tu contenido utiliza inteligencia artificial.

- Utilice la IA de forma ética: no manipule, engañe ni suplante la identidad de personas reales.

- Manténgase al día sobre la evolución de las leyes de IA y derechos de autor en su región.

- Tomar estas precauciones protege tanto la reputación de tu marca como la confianza de tu público.

Reflexiones finales

El contenido generado por IA y los deepfakes han hecho creación de contenidos Aunque es accesible para el público en general, el tema de los derechos de autor sigue siendo una preocupación importante. Esta capacidad conlleva la responsabilidad de crear contenido de forma ética y no utilizarlo para difundir información errónea.

La comunidad jurídica trabaja para lograr una regulación adecuada del contenido generado por IA. Hasta entonces, es responsabilidad de cada persona priorizar la honestidad y hacer un uso ético de la IA. regístrate ¡Utiliza esta herramienta y la IA de forma responsable!

PREGUNTAS MÁS FRECUENTES:

No siempre. Hasta ahora, los vídeos generados por IA no están protegidos por derechos de autor en muchas regiones porque son generados completamente por IA. Solo el contenido creado por humanos puede protegerse mediante las leyes de derechos de autor.

Sí, te pueden demandar por usar la imagen de alguien sin su consentimiento porque viola la privacidad y causa difamación si el contenido es engañoso o despectivo.

Algunos indicios sutiles, como una iluminación poco natural, fallos técnicos y movimientos labiales descoordinados, pueden ayudar a identificar el contenido generado por IA. Algunas plataformas de redes sociales incluso están trabajando en añadir etiquetas de IA al contenido para evitar que los usuarios sean engañados.