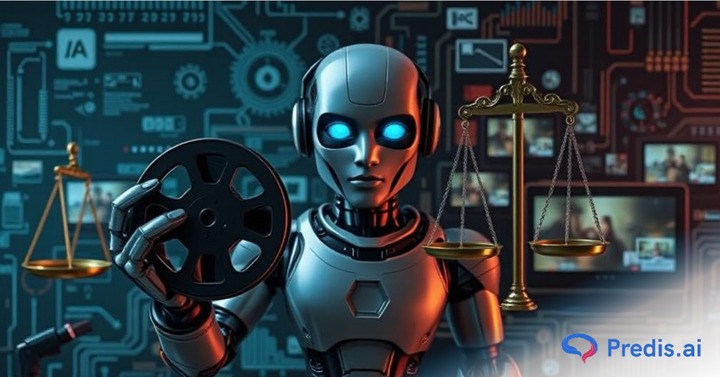

Αν είστε συνεχώς συνδεδεμένοι στο διαδίκτυο όπως εγώ, τότε θα έχετε συναντήσει βίντεο που δημιουργούνται από τεχνητή νοημοσύνη. Μερικοί από εσάς μπορεί ακόμη και να έχετε πειραματιστεί με αυτό, να έχετε δημιουργήσει βίντεο και να τα έχετε κοινοποιήσει στα κανάλια κοινωνικής δικτύωσης. Αλλά έχετε αναρωτηθεί ποτέ αν το περιεχόμενο σας ανήκει πραγματικά ή όχι;

Το περιεχόμενο που δημοσιεύετε προστατεύεται από πνευματικά δικαιώματα στο όνομά σας ή μήπως free για να επαναχρησιμοποιηθεί και να επαναχρησιμοποιηθεί από οποιονδήποτε; Αυτό ακριβώς θα εξετάσουμε στο ιστολόγιο. Τα ζητήματα πνευματικών δικαιωμάτων, οι ηθικές γκρίζες ζώνες και όλα τα ενδιάμεσα θα αναλυθούν λεπτομερώς στις επόμενες παραγράφους.

Τι είναι τα deepfakes και τα βίντεο που δημιουργούνται από τεχνητή νοημοσύνη;

Τα βίντεο που δημιουργούνται από τεχνητή νοημοσύνη χρησιμοποιούν μηχανική μάθηση και προηγμένα γλωσσικά μοντέλα για να συνθέσουν βίντεο, εικόνες και ομιλία με ανθρώπινη ομοιότητα. Από την άλλη πλευρά, τα deepfakes χρησιμοποιούνται για την ανταλλαγή προσώπων, φωνών και χειρονομιών σε βίντεο της πραγματικής ζωής.

Αυτό το περιεχόμενο χρησιμοποιήθηκε για να κάνει τα οπτικά εφέ εύκολα και για ψυχαγωγία. Αλλά αυτή η τεχνολογία έχει ξεπεράσει αυτή την εξειδικευμένη αγορά στο μάρκετινγκ, τα μέσα κοινωνικής δικτύωσης, την εκπαίδευση και ούτω καθεξής. Έχει κάνει τη δημιουργία περιεχομένου εύκολη και έχει βοηθήσει ακόμη και τις μικρές επιχειρήσεις να δημιουργήσουν περιεχόμενο με μικρότερο προϋπολογισμό.

Δυστυχώς, το deepfake και το περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη μπορούν να διαδώσουν παραπληροφόρηση και να δημιουργήσουν ζητήματα πνευματικών δικαιωμάτων, γι' αυτό και... ανίχνευση deepfake έχει καταστεί σημαντικό για την επαλήθευση της αυθεντικότητας των ψηφιακών μέσων. Αυτός είναι ο λόγος για τον οποίο τα ηθικά ζητήματα και τα ζητήματα εμπιστευτικότητας που κρύβονται πίσω από το περιεχόμενο της Τεχνητής Νοημοσύνης πρέπει να γίνουν κατανοητά, ώστε να μπορεί να χρησιμοποιηθεί υπεύθυνα.

Βελτιώστε την απόδοση επένδυσης των μέσων κοινωνικής δικτύωσης ⚡️

Εξοικονομήστε χρόνο και δημιουργήστε σε κλίμακα με AI

ΠΡΟΣΠΑΘΗΣΤΕ ΤΩΡΑΠοιος κατέχει ένα μέσο που δημιουργείται από τεχνητή νοημοσύνη;

Όταν ένας καλλιτέχνης ή δημιουργός ζωγραφίζει ή δημιουργεί ένα βίντεο, το περιεχόμενο γενικά αποδίδεται στο άτομο που δημιουργεί το έργο τέχνης. Σε αυτήν την περίπτωση, το περιεχόμενο που προστατεύεται από πνευματικά δικαιώματα και το άτομο στο οποίο ανήκει απεικονίζονται με σαφήνεια.

Αλλά το θέμα με τα μέσα που δημιουργούνται από την τεχνητή νοημοσύνη και το deepfake είναι ότι δεν υπάρχει σαφής δημιουργός και κάτοχος, πράγμα που σημαίνει ότι τα όρια πνευματικών δικαιωμάτων είναι επίσης θολά. Η τεχνητή νοημοσύνη εκπαιδεύεται σε μεγάλες ποσότητες δεδομένων, βάσει των οποίων σχεδιάζεται το τελικό προϊόν.

The Νόμοι περί πνευματικής ιδιοκτησίας εξακολουθούν να είναι αρκετά ασαφείς σχετικά με τη δυνατότητα κατοχύρωσης πνευματικών δικαιωμάτων σε περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη και, ως εκ τούτου, το αφήνουν απροστάτευτο.

Μια επιπλέον συμβουλή είναι ότι μπορείτε να τεκμηριώσετε και να αποθηκεύσετε τις δημιουργικές σας συνεισφορές, ώστε να διεκδικήσετε την ιδιοκτησία σας επί της δημιουργίας.

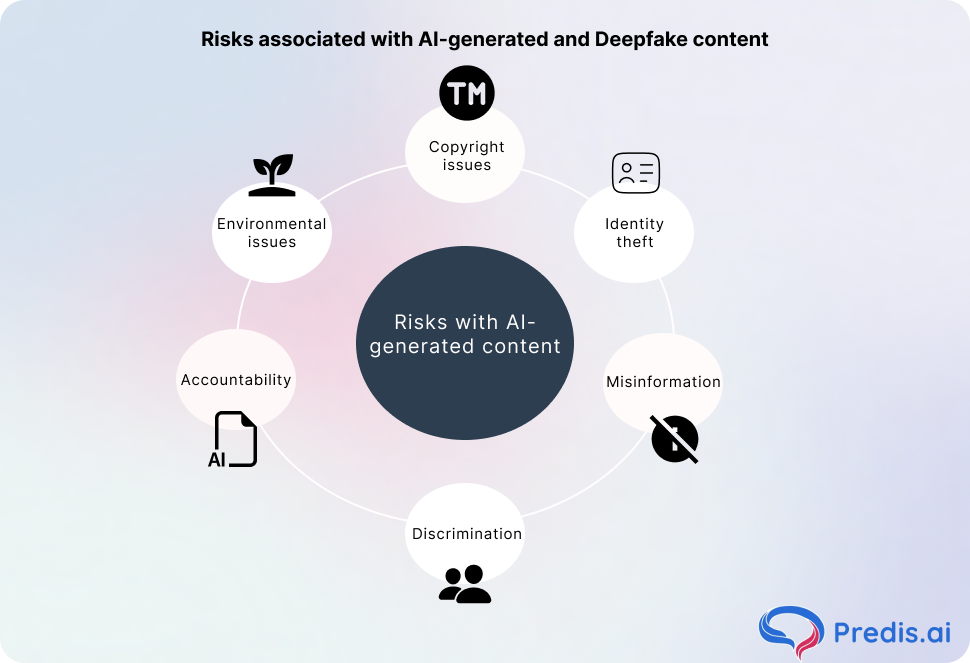

Κίνδυνοι που σχετίζονται με περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη και περιεχόμενο Deepfake

Ποιοι είναι, λοιπόν, μερικοί από τους κινδύνους που σχετίζονται με το περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη και τα Deepfakes που πρέπει να γνωρίζετε; Ακολουθούν μερικοί από αυτούς:

1. Ζητήματα πνευματικών δικαιωμάτων

Δεδομένου ότι η Τεχνητή Νοημοσύνη αντλεί τα αποτελέσματά της μαθαίνοντας από αμέτρητο διαδικτυακό υλικό, συμπεριλαμβανομένου περιεχομένου που προστατεύεται από πνευματικά δικαιώματα, το περιεχόμενο δεν μπορεί να κατηγοριοποιηθεί πλήρως ως πρωτότυπο. Στην πραγματικότητα, οι οδηγίες του γραφείου πνευματικών δικαιωμάτων των ΗΠΑ ορίζουν ότι τα έργα χωρίς ανθρώπινη πατρότητα δεν μπορούν να προστατεύονται από πνευματικά δικαιώματα.

Εάν το αποτέλεσμα που παράγεται από την Τεχνητή Νοημοσύνη μοιάζει κατά λάθος με άλλο περιεχόμενο που προστατεύεται από πνευματικά δικαιώματα, τότε θα προκληθούν νομικές επιπλοκές.

2. Κλοπή ταυτότητας

Όταν μια περσόνα που δημιουργείται από τεχνητή νοημοσύνη μοιάζει με ένα πραγματικό πρόσωπο, αυτό μπορεί να οδηγήσει σε επιβλαβή πλαστοπροσωπία. Επιπλέον, υπάρχει ρητή απαίτηση ότι δεν πρέπει να χρησιμοποιείτε την εικόνα κάποιου χωρίς τη συγκατάθεσή του. Η παραμέληση αυτού μπορεί συχνά να οδηγήσει σε σοβαρά προβλήματα, εκβιασμούς και βλάβη της φήμης.

3. Παραπληροφόρηση και χειραγώγηση

Τα deepfakes μπορούν να δημιουργήσουν εξαιρετικά ρεαλιστικό περιεχόμενο που διαδίδει ψευδείς πληροφορίες, θολώνοντας τα όρια μεταξύ πραγματικότητας και μυθοπλασίας. Όταν οι χρήστες δεν μπορούν να διακρίνουν μεταξύ ψευδών και αληθινών πληροφοριών, αυτό μπορεί να έχει σοβαρές συνέπειες. Αυτό μπορεί να επηρεάσει την πολιτική, να διαστρεβλώσει τις απόψεις των ανθρώπων, ακόμη και να θέσει σε κίνδυνο τις κοινότητες.

4. Διακρίσεις

Εάν η Τεχνητή Νοημοσύνη εκπαιδευτεί σε μεροληπτικά δεδομένα, τότε και το αποτέλεσμα που παράγει θα είναι επίσης μεροληπτικό. Αυτή η άδικη μεταχείριση μπορεί να δημιουργήσει αποτελέσματα που δεν απεικονίζουν ολόκληρη την εικόνα. Γι' αυτό θα πρέπει πάντα να διασταυρώνετε το περιεχόμενο που παράγεται από την Τεχνητή Νοημοσύνη για να βεβαιωθείτε ότι δεν εμφανίζονται μεροληπτικά μηνύματα.

5. Ευθύνη

Δεδομένου ότι το περιεχόμενο που παράγεται από την Τεχνητή Νοημοσύνη δεν έχει σαφή κάτοχο, δεν υπάρχει κανείς που να λογοδοτεί όταν διαδίδει παραπληροφόρηση. Το να κρατηθεί κάποιος υπεύθυνος και να αποφευχθεί αυτό το ατύχημα είναι σχεδόν αδύνατο, γι' αυτό και η λογοδοσία αποτελεί ηθικό ζήτημα όσον αφορά την... Περιεχόμενο που δημιουργείται από AI.

6. Αποτύπωμα άνθρακα

Όταν χρησιμοποιείται η Τεχνητή Νοημοσύνη, απαιτείται μεγάλη ποσότητα ενέργειας και υδάτινων πόρων για τη διατήρηση της λειτουργίας του συστήματος, κάτι που φυσικά οδηγεί σε περιβαλλοντικά ζητήματα. Αυτή η μεγάλης κλίμακας επίδραση στο περιβάλλον αποτελεί επίσης ένα ηθικό ζήτημα που πρέπει να αντιμετωπιστεί.

Αντιμετώπιση Ηθικών Κινδύνων: Χτίζοντας ένα Υπεύθυνο Μέλλον Τεχνητής Νοημοσύνης

Ενώ τα πνευματικά δικαιώματα και η δυσφήμιση αποτελούν σημαντικές ανησυχίες, το μεγαλύτερο ερώτημα είναι: πώς χρησιμοποιούμε την Τεχνητή Νοημοσύνη ή το deepfake υπεύθυνα; Δεν είναι απλώς νομικό ζήτημα - είναι ηθικό. Η οικοδόμηση ενός ηθικού μέλλοντος στην Τεχνητή Νοημοσύνη απαιτεί προσπάθεια από όλους τους εμπλεκόμενους: δημιουργούς, εταιρείες τεχνολογίας, υπεύθυνους χάραξης πολιτικής, ακόμη και καθημερινούς χρήστες.

Να πώς μπορούμε να ξεκινήσουμε να κάνουμε αυτή την αλλαγή.

1. Διαφάνεια και Δημοσιοποίηση

Αν χρησιμοποιείτε Τεχνητή Νοημοσύνη για να δημιουργία περιεχομένου, να είστε ανοιχτοί σχετικά με αυτό. Η επισήμανση βίντεο, εικόνων ή κειμένου ως παραγόμενων από τεχνητή νοημοσύνη δίνει στο κοινό το κατάλληλο πλαίσιο και το βοηθά να αποφασίσει πόσο να εμπιστευτεί αυτό που βλέπει. Είναι ένα απλό αλλά ισχυρό βήμα προς την ανοικοδόμηση της αξιοπιστίας σε μια εποχή συνθετικών μέσων.

2. Κανονιστικά και Νομικά Πλαίσια

Οι κυβερνήσεις και οι διεθνείς φορείς πρέπει να εκσυγχρονίσουν την ισχύουσα νομοθεσία για να αντιμετωπίσουν τον αντίκτυπο της Τεχνητής Νοημοσύνης. Αυτό περιλαμβάνει την αποσαφήνιση της ιδιοκτησίας πνευματικών δικαιωμάτων για έργα Τεχνητής Νοημοσύνης, τον καθορισμό ευθύνης για επιβλαβές ή παραπλανητικό περιεχόμενο Τεχνητής Νοημοσύνης και τη διασφάλιση ισχυρότερων προστασιών της ιδιωτικής ζωής. Ο νόμος δεν θα πρέπει να καταπνίγει την καινοτομία, αλλά πρέπει να προστατεύει το κοινό.

3. Στρατηγικές Μετριασμού της Προκατάληψης

Η Τεχνητή Νοημοσύνη αντικατοπτρίζει τα δεδομένα στα οποία έχει εκπαιδευτεί, πράγμα που σημαίνει ότι μπορεί επίσης να αναπαράγει την ανθρώπινη προκατάληψη. Οι προγραμματιστές μπορούν να μειώσουν αυτό το φαινόμενο ελέγχοντας σύνολα δεδομένων, δοκιμάζοντας μοντέλα για δίκαιη μεταχείριση και διαφοροποιώντας το εκπαιδευτικό υλικό. Αυτά τα βήματα μπορεί να ακούγονται τεχνικά, αλλά είναι κρίσιμα για να διασφαλιστεί ότι η Τεχνητή Νοημοσύνη δεν κάνει ακούσιες διακρίσεις ή στερεότυπα.

4. Εκπαίδευση και Μέσα Ενημέρωσης Liteάσεμνος

Μία από τις καλύτερες άμυνες κατά της παραπληροφόρησης είναι η ευαισθητοποίηση. Διδάσκοντας στους ανθρώπους πώς να εντοπισμός deepfakes, ο έλεγχος γεγονότων περιεχομένου και η κριτική σκέψη σχετικά με τα διαδικτυακά μέσα μπορούν να αποτρέψουν τη χειραγώγηση. Τα σχολεία, οι οργανισμοί και οι πλατφόρμες έχουν όλοι να διαδραματίσουν ρόλο στην οικοδόμηση των μέσων ενημέρωσης. liteζωηρός.

5. Βιώσιμη Ανάπτυξη Τεχνητής Νοημοσύνης

Πέρα από την ηθική και το δίκαιο, υπάρχει και το ζήτημα της περιβαλλοντικής ευθύνης. Τα συστήματα τεχνητής νοημοσύνης καταναλώνουν πολλή ενέργεια, ειδικά κατά τη διάρκεια της εκπαίδευσης. Η μετάβαση σε ενεργειακά αποδοτικά μοντέλα και πιο οικολογικές πρακτικές πληροφορικής μπορεί να κάνει την καινοτομία στην τεχνητή νοημοσύνη πιο βιώσιμη μακροπρόθεσμα.

Πώς μπορούν οι επιχειρήσεις να παραμείνουν ασφαλείς

Για τις μάρκες που χρησιμοποιούν εργαλεία τεχνητής νοημοσύνης για τη δημιουργία περιεχομένου, η πιο έξυπνη κίνηση είναι να παραμείνουν προνοητικές. Ακολουθούν μερικές γρήγορες συμβουλές:

- Να διαβάζετε πάντα τις συμφωνίες αδειοδότησης των εργαλείων Τεχνητής Νοημοσύνης πριν από τη χρήση.

- Αποφύγετε την ανάρτηση υλικού ιδιόκτητου ή προστατευόμενου από πνευματικά δικαιώματα ως δεδομένα εισόδου.

- Προσθέστε δηλώσεις αποποίησης ευθύνης ή ετικέτες εάν το περιεχόμενό σας υποβοηθείται από τεχνητή νοημοσύνη.

- Χρησιμοποιήστε την Τεχνητή Νοημοσύνη ηθικά—μην χειραγωγείτε, μην παραπλανάτε ή μιμείστε πραγματικούς ανθρώπους.

- Μείνετε ενημερωμένοι σχετικά με τις εξελισσόμενες νομοθεσίες περί τεχνητής νοημοσύνης και πνευματικών δικαιωμάτων στην περιοχή σας.

- Η λήψη αυτών των προφυλάξεων προστατεύει τόσο τη φήμη της επωνυμίας σας όσο και την εμπιστοσύνη του κοινού σας.

Κυριαρχήστε στα Social Media 🔥

Ενισχύστε την απόδοση των μέσων κοινωνικής δικτύωσης και την απόδοση επένδυσης (ROI) με AI

ΠΡΟΣΠΑΘΗΣΤΕ ΤΩΡΑ

Τελικές σκέψεις

Το περιεχόμενο που δημιουργείται από την τεχνητή νοημοσύνη και το deepfake έχουν κάνει δημιουργία περιεχομένου προσβάσιμο στις μάζες, αλλά το ζήτημα των πνευματικών δικαιωμάτων εξακολουθεί να αποτελεί σημαντική ανησυχία. Με αυτή την ικανότητα έρχεται η ευθύνη να δημιουργείται περιεχόμενο ηθικά και να μην χρησιμοποιείται για τη διάδοση παραπληροφόρησης.

Η νομική κοινότητα εργάζεται για την επίτευξη ενός σημείου όπου το περιεχόμενο που παράγεται από την Τεχνητή Νοημοσύνη μπορεί να ρυθμιστεί σωστά. Μέχρι τότε, είναι ευθύνη κάθε ατόμου να δώσει προτεραιότητα στην ειλικρίνεια και να κάνει ηθική χρήση της Τεχνητής Νοημοσύνης. Έτσι, εγγραφείτε για αυτό το εργαλείο και χρησιμοποιήστε την Τεχνητή Νοημοσύνη υπεύθυνα!

FAQ:

Μέχρι στιγμής, όχι πάντα, τα βίντεο που δημιουργούνται από τεχνητή νοημοσύνη δεν προστατεύονται από πνευματικά δικαιώματα σε πολλές περιοχές, επειδή παράγονται πλήρως από τεχνητή νοημοσύνη. Μόνο το περιεχόμενο που δημιουργείται από ανθρώπους μπορεί να προστατευθεί με τη βοήθεια των νόμων περί πνευματικών δικαιωμάτων.

Ναι, μπορείτε να μηνυθείτε για χρήση της εικόνας κάποιου χωρίς τη συγκατάθεσή του, επειδή παραβιάζει το απόρρητο και προκαλεί δυσφήμιση εάν το περιεχόμενο είναι παραπλανητικό ή υποτιμητικό.

Ορισμένα ανεπαίσθητα σημάδια, όπως ο αφύσικος φωτισμός, οι δυσλειτουργίες και οι ασύμβατες κινήσεις των χειλιών, μπορούν να βοηθήσουν στον εντοπισμό περιεχομένου που δημιουργείται από τεχνητή νοημοσύνη. Ορισμένες πλατφόρμες κοινωνικής δικτύωσης εργάζονται ακόμη και για την προσθήκη ετικετών τεχνητής νοημοσύνης στο περιεχόμενο, για να διασφαλίσουν ότι οι χρήστες δεν θα παραπλανηθούν.